L'AI al lavoro funziona, ma non come vi avevano detto

Il MIT ha studiato per tre anni come le aziende usano davvero l'AI generativa. I risultati smontano parecchie certezze.

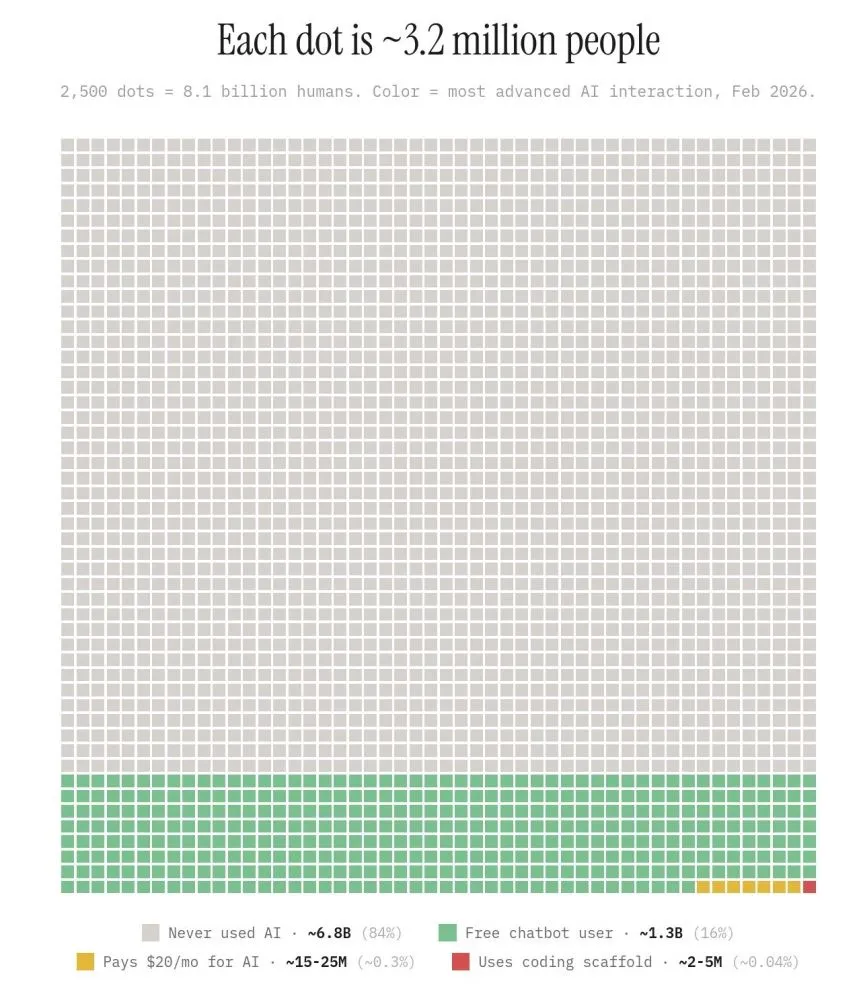

A gennaio 2026, circa la metà dei lavoratori americani dichiara di usare l'AI. Ma quando si va a guardare cosa fanno con questi strumenti, e soprattutto cosa è cambiato nel loro lavoro quotidiano, la storia diventa meno nitida di quanto suggeriscano i titoli dei giornali. Il MIT ha appena pubblicato "Humans in the Loop", un report che raccoglie tre anni di osservazione diretta su più di venti grandi aziende americane distribuite tra sanità, retail, finanza e manifattura. Non è un paper teorico sui task che l'AI potrebbe automatizzare, e nemmeno l'ennesima simulazione sui posti di lavoro a rischio. È un diario di bordo di quello che succede quando le aziende provano davvero a far funzionare l'AI generativa nei loro processi, con persone vere, problemi veri, e budget che a un certo punto qualcuno chiede di giustificare. Il quadro che ne esce è più interessante delle profezie che siamo abituati a sentire, e parecchio più complicato.

Tre problemi, nessuno dei quali è "sostituire le persone"

Una delle cose più utili che fa il report è dare un nome ai problemi che le aziende stanno cercando di risolvere con l'AI generativa. Non sono problemi nuovi, peraltro, e questo è già di per sé una notizia. Il primo è quello che i ricercatori chiamano *bottleneck problem*: i professionisti passano una quota crescente del loro tempo su task semi-ripetitivi che richiedono competenza ma non la sfruttano davvero, e che li tengono lontani dal lavoro a maggior valore aggiunto. I medici che passano le sere a rispondere ai messaggi dei pazienti o a compilare note cliniche. Gli avvocati che setacciano corpus di documenti alla ricerca di clausole simili ma non identiche. Gli ingegneri software che scrivono unit test. L'AI generativa, in questi casi, produce una bozza che il professionista rivede e corregge, e il risparmio di tempo è reale anche se difficile da quantificare con precisione. Il secondo è il *cafeteria problem*, che ha un nome delizioso: per completare certi progetti serve raccogliere l'input di esperti sparsi per l'organizzazione, e fino a ieri l'unico modo era andare letteralmente in mensa a cercarli per chiedere il loro parere. Bristol Myers Squibb, per esempio, ha usato l'AI per accelerare la preparazione delle pratiche di approvazione dei farmaci alla FDA, un processo che richiede di assemblare informazioni provenienti da anni di sperimentazione, trial clinici e documentazione interna. L'idea è che l'AI possa anticipare quello che gli esperti avrebbero detto sulla base di quello che hanno già scritto in passato. Il terzo problema è la *learning curve*: aiutare chi è nuovo in un campo a orientarsi più in fretta. Un retailer americano (nel report si chiama Tau) ha messo nelle mani dei commessi un tablet con un chatbot alimentato dai dati aziendali, e ha scoperto che i dipendenti non lo usavano solo per rispondere ai clienti. Alcuni ci ponevano domande sulle dinamiche del proprio team, o esprimevano insicurezze che non avrebbero mai comunicato a un manager. Uno strumento pensato per la produttività era diventato, senza che nessuno lo avesse previsto, un canale di feedback dal basso.

Da esecutori a supervisori, con tutti i rischi del caso

Il pattern comune a tutte queste applicazioni è che il lavoratore passa dall'esecuzione diretta di un task alla supervisione dell'output di un sistema automatico. I ricercatori del MIT lo chiamano *supervisory control*, e fanno notare che non è un concetto nuovo: piloti di linea, operatori di centrali nucleari e tecnici nelle fabbriche automatizzate fanno esattamente questo lavoro da decenni, e la letteratura sulle condizioni che rendono questi ruoli efficaci (o disastrosi) è sterminata. Il punto è che la qualità di questi lavori di supervisione varia enormemente. Chi supervisiona sistemi complessi nell'aviazione o nel nucleare fa un lavoro considerato interessante e ben pagato. Chi supervisiona macchinari automatici in una fabbrica guadagna spesso meno e fa più fatica a trovare motivazione. Con l'AI generativa rischia di succedere la stessa cosa: ci saranno ruoli di supervisione che richiedono giudizio, interpretazione e competenza di dominio, e ruoli che si limitano a cliccare "approva" su contenuti generati automaticamente senza avere gli strumenti per valutarli davvero. E qui emerge una delle preoccupazioni più serie del report, che riguarda il cosiddetto *mental offloading*. Uno studio citato sui risultati degli studenti universitari che usavano ChatGPT per compiti di ricerca mostra che questi avevano un'attività cerebrale inferiore e una capacità di ricordare il proprio lavoro molto più bassa rispetto a chi usava un motore di ricerca tradizionale o la propria memoria. In parole povere: il task veniva completato, ma lo studente non imparava nulla nel processo. Se estendi questa dinamica al mondo del lavoro, il rischio è che gli strumenti pensati per aiutare le persone a salire la curva di apprendimento finiscano per tenerle permanentemente in pianura.

La vendetta del CFO

C'è un passaggio nel report che vale da solo la lettura. Dopo la fase iniziale di sperimentazione entusiasta, dove le aziende aprivano sandbox per i dipendenti e misuravano il successo in base al numero di utenti, è arrivato quello che i ricercatori chiamano "the revenge of the CFO". A un certo punto qualcuno ha chiesto: bene, ma quanto ci costa e quanto ci fa guadagnare? E le risposte, per molte applicazioni, non c'erano. Le aziende studiavano il risparmio di tempo, ma spesso trascuravano di misurare le conseguenze sulla qualità del lavoro, sulla necessità di revisione dell'output AI, e sui costi indiretti. Un produttore manifatturiero, a un certo punto, ha smesso del tutto di cercare di misurare i guadagni di produttività dall'AI perché c'erano troppe variabili in gioco: la domanda dei prodotti, la capacità del team, la catena di fornitura. Dove invece riuscivano a misurare qualcosa era nelle nuove capacità che l'AI dava ai lavoratori, e questo è un indicatore diverso dalla produttività classica e molto più difficile da tradurre in un foglio Excel per il consiglio di amministrazione. Si è anche verificato un fenomeno prevedibile ma istruttivo: molte aziende sono passate dal costruire le proprie applicazioni AI internamente (la fase degli hackathon interni e dei tool customizzati) al comprare soluzioni già pronte dai vendor. Il che ha senso economico, ma solleva una domanda strategica che il report pone senza rispondere del tutto: se le aziende smettono di sviluppare competenze tecniche interne e si affidano ai fornitori, cosa succede alla loro capacità di capire davvero cosa fanno gli strumenti che usano?

Agenti, il prossimo capitolo di una storia già sentita

Il report dedica una sezione agli agenti AI, e lo fa con un tono che definirei sobrio fino alla severità. Gli agenti, osservano i ricercatori, rappresentano un'evoluzione incrementale rispetto alla Robotic Process Automation, che esisteva già e che aveva limiti noti: funzionava solo su task completamente routinari, e quando il processo cambiava bisognava riprogrammare tutto. Gli agenti possono gestire variazioni e task semi-strutturati, il che è un progresso reale. Ma l'idea che possano togliere l'umano dal circuito per la maggior parte dei task ad alta posta in gioco resta, al momento, più una promessa commerciale che un dato di fatto osservabile. Per i task dove la qualità conta e le variabili sono molte, il supervisore umano finisce per giocare un ruolo ancora più critico che nei sistemi di automazione tradizionale, proprio perché il sistema prende decisioni meno prevedibili. È un paradosso che chi ha lavorato con sistemi automatici conosce bene: più il sistema è autonomo, più il supervisore deve essere competente per intervenire nei momenti giusti.

Cosa non è successo

Forse la parte più significativa del report è l'elenco delle cose che non sono accadute. Le aziende studiate non hanno fatto licenziamenti di massa legati all'AI. I processi di adozione sono stati incrementali, con la maggior parte delle organizzazioni ancora nella fase del proof of concept dopo tre anni. La promessa che l'AI avrebbe livellato le competenze, beneficiando soprattutto i meno esperti, si è verificata solo in parte: per i task legati alla curva di apprendimento sì, i meno esperti guadagnano di più dall'uso dell'AI. Ma per i task che richiedono di integrare informazioni da fonti diverse o di gestire colli di bottiglia documentali, serve comunque una competenza di dominio solida per valutare se l'output dell'AI ha senso o se sta producendo spazzatura ben confezionata. E l'idea che le aziende potessero usare l'AI per scavalcare i propri limiti infrastrutturali (dati disorganizzati, documentazione frammentaria, assenza di database strutturati) si è scontrata con la realtà: senza una base di dati ordinata che faccia da riferimento, non c'è modo di verificare se quello che l'AI restituisce è affidabile, e quindi non c'è modo di costruire fiducia nello strumento. Detto altrimenti: l'AI generativa non è una scorciatoia per chi non ha fatto i compiti a casa con i propri dati.

Dieci lezioni che valgono anche per l'Italia

Il report chiude con dieci raccomandazioni pratiche, e alcune sono più interessanti di quanto sembrino a prima vista. La prima è la più ovvia e la più ignorata: raccogliere evidenze prima di scalare. Le applicazioni AI che hanno funzionato meglio erano quelle che rispondevano a problemi già identificati e studiati prima che l'AI generativa esistesse. Chi aveva un problema chiaro sapeva cosa cercare, sapeva come misurare il successo, e sapeva quando fermarsi. La seconda riguarda la diversità nell'uso degli strumenti. I lavoratori usano l'AI in modi molto diversi anche quando fanno lo stesso lavoro, e questa variabilità è un vantaggio per le organizzazioni che hanno la pazienza di osservare cosa funziona e in quali condizioni, invece di imporre un unico modello dall'alto. Ma le raccomandazioni che mi hanno colpito di più sono quelle sulla conservazione del lavoro di squadra e sulla competenza di dominio. Il report segnala che alcune aziende hanno notato un calo della collaborazione tra colleghi da quando l'AI permette di completare individualmente compiti che prima richiedevano l'apporto di un team. Il che porta un risparmio di tempo immediato e misurabile, ma fa perdere tutto quello che il lavoro collaborativo produce in termini di apprendimento condiviso, fiducia reciproca e capacità del gruppo di affrontare problemi futuri. Sulla competenza di dominio, i ricercatori arrivano a una conclusione che suona controintuitiva ma che è perfettamente logica: proprio perché l'AI generativa può produrre grandi volumi di output in campi come la medicina, l'informatica e le scienze della vita, serviranno più esperti di dominio, non meno, per valutare, interpretare e testare quello che l'AI produce. Chi immagina che l'AI renderà superflui i giovani professionisti potrebbe scoprire, tra qualche anno, di aver creato un collo di bottiglia ancora peggiore di quelli che cercava di risolvere.

Una storia appena cominciata

Tre anni di osservazione su grandi aziende americane sono un campione limitato, e i ricercatori del MIT lo sanno. Le organizzazioni studiate sono soprattutto incumbent di settori tradizionali, non le startup AI-native che potrebbero un giorno ridisegnare intere industrie partendo da zero. E il fatto che i cambiamenti osservati finora siano incrementali non significa che lo resteranno per sempre. Ma proprio per questo il report ha valore: fotografa il momento in cui le aziende stanno ancora decidendo come usare questi strumenti, e documenta le scelte, gli errori, e le sorprese di questa fase. Chi prende decisioni oggi su come integrare l'AI nel lavoro farebbe bene a leggerlo, perché la differenza tra una transizione gestita e una caotica si gioca adesso, nelle scelte operative e di design che sembrano piccole ma che definiranno la forma del lavoro nei prossimi anni. *Il report completo "Humans in the Loop: The Evolution of Work in Early Experiments with Generative AI" è disponibile gratuitamente sul sito dell'MIT Industrial Performance Center.*

---

Questo articolo è una versione rielaborata del pezzo pubblicato nella rubrica IA Upgrade su [HWUpgrade.it](https://www.hwupgrade.it/).

Vuoi applicare queste strategie alla tua azienda? Parliamone.

Prenota una Discovery Call gratuita